Finde den Fehler! / Foto: Ki-generiert mit Gemini/ Martha Giannakoudi

Über Deepfakes, diffuses Misstrauen und die Kunst, trotzdem urteilsfähig zu bleiben

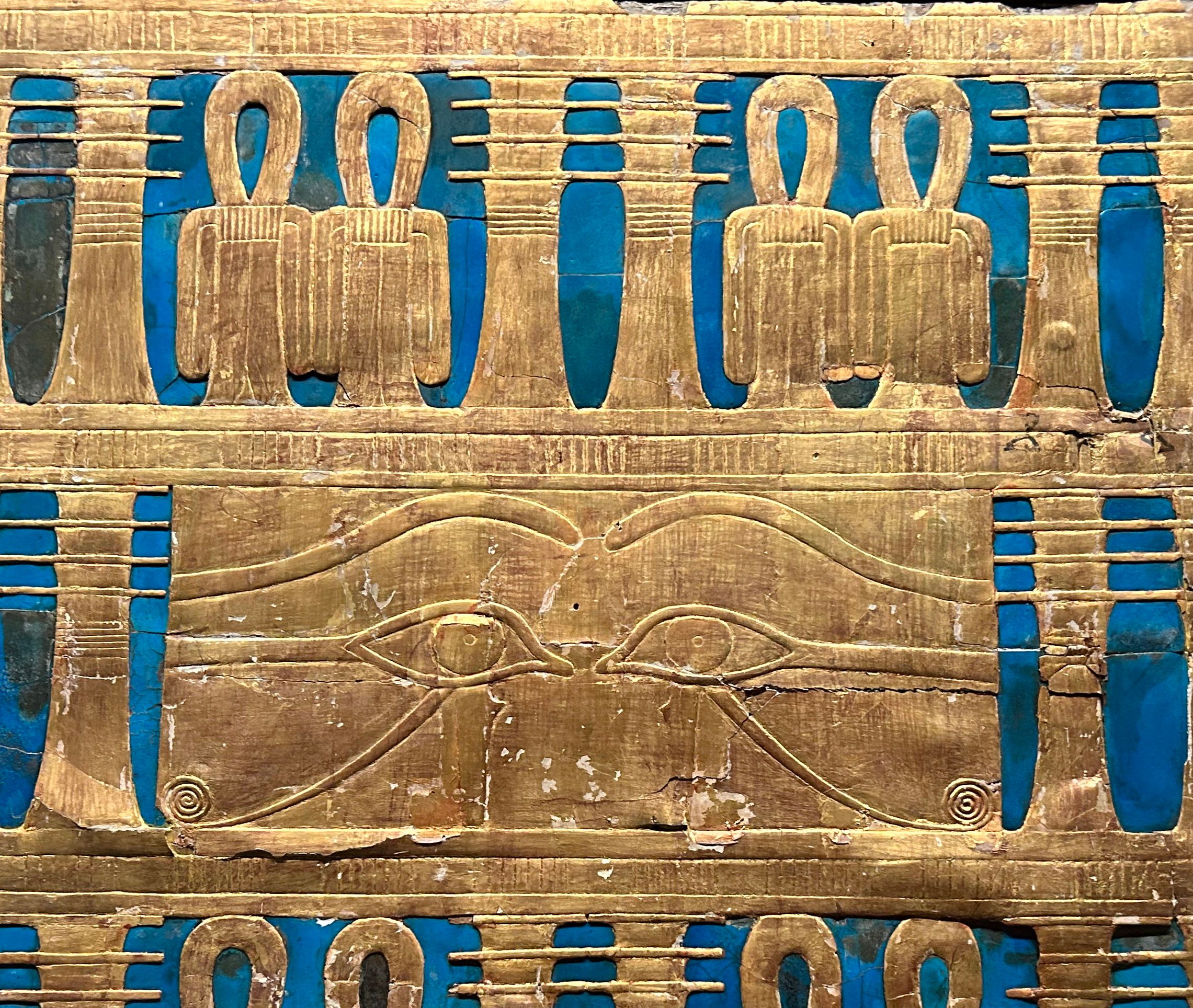

Sehen ist glauben. Das wussten schon die alten Ägypter. Die Grabstätten der Pharaonen, die Tempelanlagen am Nil, das viele Gold – alles diente einem Ziel: Wer könnte so viel Schönheit und Macht anzweifeln? Bilder waren der Beweis, dass die Pharaonen Götter waren. Sehen bedeutete glauben.

Nun bricht eine neue Epoche des Sehens an. Und diesmal läuft es umgekehrt.

Denn mit den Möglichkeiten der KI und den Deepfakes können wir ja unseren Augen und Ohren nicht mehr trauen. Eine Entwicklung, die sich nicht mehr zurückdrehen lässt.

Auch bei mir bemerke ich eine Veränderung und dabei gab es keinen dramatischen Schlüsselmoment. Es ist eher so, als hätte jemand leise den Kontrast an meinem inneren Bildschirm verändert. Ich lese Nachrichten anders. Ich schaue Bilder und insbesondere Videos anders. Ich höre Stimmen anders.

Nicht mit grundsätzlichem Misstrauen, sondern eher mit einer neuen Vorsicht, einem kleinen Innehalten, das früher nicht da war.

KI-Expertin: Martha Giannakoudi, Geschäftsführerin des Düsseldorfer Beratungsunternehmens Synnous

Der Moment, in dem ich reingefallen bin

Eskalation im Nahen Osten auf Instagram. Der Iran hatte Raketen auf das Hotel Burj Al Arab, das Wahrzeichen Dubais, abgefeuert. Auf ein Symbol westlicher Modernität, das der Iran als Zeichen dekadenter Weltordnung vernichten will.

Die Nachricht entsprach der Realität. Aber nur zum Teil. Es hatte tatsächlich durch Trümmer einen kleinen Brand und Rauch in einem Hochhaus gegeben. Natürlich ein ernster Vorfall. Eine beunruhigende Eskalation.

Aber dann kamen die Videos. Auf Social Media verbreiteten sich Aufnahmen, die den Burj Al Arab lichterloh brennend zeigten. Szene für Szene dramatischer. Flammen, die das ikonische Segelgebäude zerstören. Laute Stimmen und Schreie im Hintergrund. Ich habe diese Videos gesehen und für einen Moment auch geglaubt, sie seien echt.

Nicht weil ich leichtgläubig bin. Sondern weil die Bilder auf dem kleinen Handybildschirm echt wirkten. Weil der Kontext scheinbar stimmte. Weil mein Gehirn aus dem emotionalen Input blitzschnell eine Realität konstruierte, die es so nicht gab. Es war alles KI-generiert.

Was gerade passiert

KI kann heute aus einem einzigen Foto ganze Videos gestalten, Gesichter tauschen, Stimmen klonen, brennende Gebäude erfinden – in einer Qualität, die selbst geschulte Redaktionen nicht mehr zuverlässig erkennen.

Das zeigte uns auch der Skandal im ZDF im Februar: Ein KI-generiertes Video, inklusive Wasserzeichen, über angebliche Abschiebungen Minderjähriger durch die US-Behörde ICE wurde ausgestrahlt, ohne als KI-generiert deklariert zu werden. Im Nachhinein als „handwerklicher Fehler“ eingeräumt.

Horus-Augen am Schrein des Pharaos Tutankhamun/ Copyright: Grand Egyptian Museum Cairo

Das ZDF, eine der verlässlichsten Nachrichtenquellen Deutschlands. Ich saß da und dachte: Wenn es dem ZDF passiert – was bedeutet das für uns alle?

Das Erschreckende ist nicht das einzelne gefälschte Video. Das Erschreckende ist die Wirkung auf uns alle. Denn das Misstrauen kommt nicht erst dann, wenn wir betrogen wurden. Es kommt bereits, wenn wir wissen, dass es möglich ist.

Ich vergleiche es mit dem Moment, in dem man hört, dass Taschendiebstahl in einem bestimmten Stadtteil verbreitet ist. Ab diesem Moment greift man automatisch an die Jackentasche. Nicht, weil man gerade bestohlen wird, sondern weil das Wissen allein das Verhalten verändert.

So ist es mit Deepfakes. Leise. Graduell. Und meistens unbemerkt.

Je mehr KI – desto mehr Mensch

Ich bin froh, dass ich meine Firma „Syn-nous“ genannt habe. Also: „mit Verstand“ (griechisch). Erst denken, dann konsumieren. Drei Fragen helfen mir dabei, mein Urteilsvermögen zu trainieren, ohne in Paranoia zu verfallen:

Erstens: Quellen statt Inhalte bewerten

Nicht „Ist dieses Video echt?“, sondern „Wer hat es veröffentlicht, warum jetzt, und wem nützt es, wenn ich es glaube?“ Diese drei Fragen allein verändern alles.

Zweitens: Verlangsamung als Kompetenz

Das Innehalten ist gerade die radikalste Geste. Das erste Gefühl prüfen, bevor man teilt, kommentiert, urteilt. Eine Sekunde länger schauen. Eine Frage mehr stellen.

Drittens: echte Gespräche als Korrektiv

Das persönliche Gespräch, der direkte Austausch, das ist in einer Welt voller synthetischer Inhalte wichtiger denn je. Nicht weil KI böse ist, sondern weil Menschlichkeit kein Algorithmus ist. Ein echter Blick, ein echtes Zögern, ein echtes Lachen. Das ist nicht reproduzierbar.

Je mehr KI in unsere Welt dringt, desto mehr brauchen wir Menschen, die Verantwortung für Wahrheit übernehmen. In Redaktionen. In Unternehmen. In Verwaltungen. In Schulen und Universitäten. In Kirchen. Und in uns selbst.

Das Burj Al Arab steht noch. Mein Urteilsvermögen auch. Aber ich trainiere es bewusster als je zuvor.

Martha Giannakoudi

// Martha Giannakoudi gründete 2010 das Beratungsunternehmen Synnous mit Sitz im Düsseldorfer Medienhafen. Spezialisiert auf Personalmanagement und digitale Transformation, begleitet sie Unternehmen dabei, Technologie und Menschlichkeit in Einklang zu bringen.

// Seit 2023 bietet Synnous diverse KI-Formate an. 2024 folgte die Gründung der „KI Business School“ mit dem IHK-Abschluss zum „KI Business Manager“. Das Ziel ist Fach- und Führungskräfte und Unternehmen zu befähigen, KI strategisch und verantwortungsvoll einzusetzen.

// 2025 erschien ihr Buch „Ethische KI in der Praxis – Die 7 Säulen und 33 Sprichwörter für KI-Werte-Leitlinien in Unternehmen“ bei Springer Gabler.

KI Afterwork VII: Wie personalisiere ich meine KI?

23.04.2026, 18:00 – 21:30 Uhr

Ort: Lettinis, Jahnstr.36, 40215 Düsseldorf

Preis: 79 € – Speisen und Getränke sind im Preis inbegriffen.

Jetzt hier anmelden!